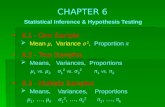

The Element of Statistical Learning Data Mining, Inference and Prediction

description

Transcript of The Element of Statistical Learning Data Mining, Inference and Prediction

The Element of Statistical LearningData Mining, Inference

and Prediction

Cluster Analysis and Self-Organizing MapsAnaliza skupień i metody SOM

Trevor Hastie, Robert TibshiraniJerome Friedman

Marta Leniewska

Przykład klasteryzacji

Reprezentacja danych x1, …, xN

Macierze podobieństwa D (N×N) Symetryczne, dij 0, dii = 0,

Obiekty xi Rp

Różnica na atrybucie Atrybut ilościowy:

Porządkowy: zamiana na ilościowy Nominalny: macierze podobieństwa L (M×M) między

wartościami atrybutu

,)( 2' jiij xx

,' jiij xx )),(1(2)( '

2' iij jiij xxxx

),( ' jiijj xxd

Różnice między obiektami

Wpływ atrybutu Xj na

(średnia różnica między obiektami)

błąd kwadratowy: - estymator Var(Xj) z próby

Równe wpływy atrybutów: Wyróżnianie pewnych atrybutówBrakujące wartości atrybutów: pomijanie, wprowadzanie, nowa wartość zmiennej

),,(),( '1

' jiij

p

jjjii xxdwxxD

p

jjw

1

1

p

jjj dwD

1

),( 'ii xxD

jjd var2

jvar

jj dw /1

Algorytmy kombinatoryczneUstalone z góry K < N klastrów Cel: funkcja k = C(i) minimalizująca rozrzut wewn.

= W(C) + B(C)

Ilość podziałów N danych na K klastrów Liczba Stirlinga 2 rodz. S(10,4) = 34.105 S(19,4) 1010

Algorytmy znajdujące lokalne minima

K

k kiC kiC kiCiiii ddT

1 )( )'( )(''2

1

NK

k

kK kkK

KKNS

1

)1(!

1),(

)1,1(),1(),( kNSkNSkKNS

Algorytm K średnichZałożenia: atrybuty ilościowe, miara zróżnicowania: kwadrat odległości euklidesowej, Nk – ilość elementów klastra k

Kryterium:

Znaleźć min centra mk dla wybranych klastrów C

(średnie), koszt ~ (ilość elementów klastra) Znaleźć min podział na klastry C

Do braku zmian C, zbiega do min lokalnego

K

k kiCkik

K

k kiC kiCii xxNxxCW

1 )(

2

1 )( )'(

2'2

1)(

K

k kiCkik

mCmxN

Kk 1

2

)(}{, 1

min

Inne wersje K średnich

Wersja probabilistyczna: algorytm EM – dopasowanie do modelu mieszaniny rozkładów Gaussa. Wersja ulepszona: żadna pojedyncza zmiana przypisania obserwacji do klastra nie polepszy wyniku.

Zastosowanie – kompresja

Podział na bloki po m pixeli – wektory w Rm

Aproksymacja bloków centrami klastrówObraz skompresowany: log2K na blok + mK

czyli log2K/8m oryginału

Lepiej przy zastosowaniu teorii ShannonaDziała bo wiele bloków wygląda tak samoMiara deformacji obrazu - straty

Przykład

Sir Ronald A. Fisher(1890-1962)oryginał

K = 200,m = 4,0,239 oryginału,Deformacja: 0,89

K = 4,m = 4,0,063 oryginału,Deformacja: 16,95

Rozmyte K średnich

Rozmyty pseudopodział – rozmyty K podziałP = {A1, ..., AK}

PrzykładN=3, K=2P = {A1, A2}

A1 = 0.6/x1 + 1/x2 + 0.1/x3

A2 = 0.4/x1 + 0/x2 + 0.9/x3

,1)(1

K

kik xA NxA

N

iik

1

)(0

••

•

0.20.40.60.81.0

••

•x1 x2 x3

0.0

Rozmyte K średnichCentrum rozmytego klastra Ai

v R, v > 1

Minimalizacjawskaźnika Znaleźć centra dla wybranych klastrów P(t-1)

Znaleźć podział na klastry P(t)

zmiana Ak(xi)

Kryterium stopu:

N

ii

N

iii

k

kw

xkwm

1

1

)(

)(

viki xAkw )]([)(

N

i

K

kkiiv mxkwPJ

1 1

2)()(

)()(max )1()(

,

)1()(i

tki

tkki

tt xAxAPP

C.d.

v 1, uogólnienie K średnichv , bardziej rozmytyzbieżny dla każdego v (1, )

Przykład K = 2 v = 1,25

x1

x2

x3

x4

x5

x6

x7 x8 x9 x11

x10

x12

x13

x14

x15

i

A1(xi)

A2(xi)

xi1

xi2

Algorytm K medoidów

Medoid – element centralnyUogólnienie K średnich na dowolne atrybuty i odległości.Kryterium:

Znaleźć min centra xik

dla wybranych klastrów C

(medoidy)koszt dla klastra ~ (ilość elementów klastra)2

Znaleźć min podział na klastry C

K

k kiCii

iC kKk

d1 )(}{, 1

min

Przykład K medoidów

12 krajówK = 3USA, ISR, FRA, EGY, BELZAI, IND, BRAYUG, USS, CUB, CHI

Inna wersja – CLARA

Kilka (np. m = 5) próbek liczności 40+2K Dla każdej próbki – minimalizacja bezp. przez iteracyjne zmiany medoidów (PAM)Koszt iteracji = O(K(N-K)2)Wybór tego z m układów medoidów który jest najlepszy dla wszystkich danych

Kwestie praktyczne

Wybór K* początkowych centrów Podać centra lub indeksy lub koder C Losowo lub krokowo minimalizując kryterium

Estymacja K* Rozrzut w klastrach ~ 1/K Rozrzut dla K<K* i dla K>K* K* odpowiada zgięciu wykresu

Statystyka Gap

0,0

0,5

1,0

1,5

Metody hierarchiczne

Nie wymagają K, tylko miary odległości między grupami obserwacjiKlastry na poziomie M tworzone przez łączenie klastrów z poziomu M-1Poziom min: N klastrów {xi}, poziom max: {x1, ..., xN}

Strategie aglomeracyjne i dzielące, N poziomówUporządkowany ciąg poziomów ~ podziałówWybór poziomu np. statystyka Gap

Dendrogram

Dendrogram jako opis danych

Ocena reprezentacyjności: wspólczynnik korelacji między dii’ a Cii’

Cii wysokość pierwszego wspólnego klastra N różnych na N(N-1)/2 Cii’ <= {Cik, Ci’k} (trójkąty równoramienne)

Metody aglomeracyjne

Od singletonów, do 1 klastra Miary odległości między klastrami G i H: Single Linkage – najmniejsza odległość Complete Linkage – największa odległość Group Avarage – średnia odległość

'',min),( iiHiGiSL dHGd

'',max),( iiHiGiCL dHGd

Gi Hi

iiHG

GA dNN

HGd'

'1),(

GA, CL, SL - dendrogramy

Przykład

Metody dzieląceGdy chcemy otrzymać mało klastrówCiąg podziałów metodą K=2 średnich/medoidów Zależy od początkowej konfiguracji w każdym kroku Nie zawsze otrzymamy własność monotoniczności

Albo Obiekt najbardziej odległy od reszty w klastrze G

do klastra H Obserwacje bliższe H niż G: najbliższa H do H Klaster do podziału – max średnica, lub średni rozrzut

wewnętrzny Do singletonów lub nierozróżnialności w klastrach

Hierarchiczne metody rozmyte

Rozmyta relacja równoważności R na X2

R(x,x) = 1 R(x,y) = R(y,x) x,yXx,zX

-cut rozmytego zbioru A: A = {x | A(x) }

0,2A = {x1, x2}, 0,4A = {x1}

)],(),,(min[max),( zyRyxRzxRXy

•0.20.4

•x1 x2

0.0

A(x)

Hierarchiczne metody rozmyte

R to crisp relacja równoważności – pary podobne Znaleźć odpowiednią relację R(lub relację kompatybilności i jej tranzytywne domknięcie)

gdzie q > 0,

Tranzytywne domknięcie R to RT = R(n-1)

qp

j

q

jiijii xxxxR1

1'' )(1),(

),(max '', iiiixxR

Przykład dla q=2

xi1

xi2

x1

x2

x3

x4

x5

Self-Organizing Maps

Wersja K średnich – prototypy na 1 lub 2 wymiarowej rozmaitości w przestrzeni atrybutów, mapowanie obserwacji na rozmaitośćMacierz K prototypów mj Rp,

o współrzędnych lj R2

Inicjalizacja – np. na płaszczyźnie wyznaczonej metodą głównych składowychRegularne rozmieszczenie prototypów na płaszczyźnieWyginanie płaszczyzny

Algorytm SOMZnajdź mj najbliższy xi w Rp

Przesuń bliskich sąsiadów mj wg. lj do xi

Wskaźnik uczenia maleje od 1 do 0Próg r maleje od R do 1Albo: przesunięcie zależne od odległości do mj

Sąsiedztwo mj zawiera tylko mj K średnich

)( kikk mxmm

))(( kikjkk mxllhmm

1.

2.

3.

SOM aproksymacją K średnich

Porównać błędy rekonstrukcji:Przykład: porównanie z K = 25 średnich

2

jmx

k

kkj w

xwm

Zastosowanie

http://websom.hut.fi/websom

WEBSOM – rzutowanieartykułów z newsgroupwg. tematyki

artykuł jako wektor wystąpień ustalonych terminów

opcja zoom

Średnica zbioru punktów

•

••

••

••

•

•

•• •

•

• • •

•

Średnia zbioru punktów

•

••

•

••

•

•

Medoid zbioru punktów

•

••

•

••

•

•

Odległość międzygrupowa