הכללה ואבחנה – הסקת מודלים של העולם

description

Transcript of הכללה ואבחנה – הסקת מודלים של העולם

הכללה ואבחנה – הסקת מודלים של העולם

מבוא ללמידה והתנהגות: התניה ומח

10שעור

נושאיםהכללה ואבחנה – מה חיות יכולות ללמוד?•תאוריות ותמיכה נסיונית: •

R-Wתאוריות של אלמנטים – הרחבה של –Pearceתאוריות קונפיגורליות – –

חיפוש עקרון מנחההשאלות המרכזיות ••Occam’s razor והסקה לגבי מודל של latent causes :

איך ניתן להסיק מתי להכליל ומתי להבחין?

סיכום הקורס: מה היה לנו עד כה•

XORחזרה לבעית ה- XORחיות יכולות ללמוד בעיות לא לינאריות כמו למשל בעית •

(negative patterning) :A+B+ABo

לא יכול (לינארי)R-Wחוק הלמידה של •)elementsפתרון פשוט: הוספת יחידות (•

נוספות לצירופים השונים

AB: Vtotal = VA + VB + VABבעת הצגת •

למידה נפרדת עבור כל יחידה• יהיה ABלאחר למידת האבחנה ליחידה •

2Rערך שלילי השווה ל-

תופעה בסיסית נוספת: עקומת הכללה, מבחן עם גירוי שונה ממנו במקצת Aבאימון עם גירוי •

CR: Generalization decrementיראה פחות מידת ההפחתה קשורה במידת הדמיון בין הגירוי החדש •

והגירוי המקורי: בעצם כל גירוי הוא גירוי המורכב RWאותו פתרון ב-•

מהרבה תתי-אלמנטים העוברים כל אחד התניה בנפרד. גירוי שונה במעט מכיל חלק מאותם אלמנטים אך לא את

הפחתה של התגובה (=הערך המנובא)כולם גם גורר הפחתת הכללה...AB ואח"כ מבחן עם +Aאבל: •

elemental theoriesבעיות נוספות עם ניבוי: אבחנה יותר טובה כאשר ההבדלים בין הגירויים •

קטנים!AC+; ACBo ל- A+;ABoנשווה למידה של –C ועל A, למידה על +ACבצעד הראשון – טעות ניבוי גדולה – ניבוי כבר יותר גדול ACBoבצעד השני –

Bיותר ויותר למידה של ערך שלילי ל-AB+;ABCo יותר מ-איטית A+;ABCoבאותה מידה: למידה של –AC+

ACBo

AC+

ACBo

נסיון נוסף לפתרון: תחרות על משאבי למידה

נניח שיש פחות למידה על גירוי ככל שיש יותר גירויים:•פותר את הבעיות הנ"ל•

+AB+/BC+/CA או +A+/B+/Cאבל: אימון של • R-W – איזו קבוצה תגיב יותר? מה ABCבמבחן עם

מנבא?

בעצם: נראה שהעקרון המנחה הוא שלמידה של אבחנה •) ביניהםsimilarityבין גירויים תלויה בדמיון (

)VR(V TT

AA

Pearce – Configural theoryגירוי שמוצג יכול לגרור הפעלה של מספר יחידות• את הקונפיגורציה של הגירוי בדיוק זו המייצגת רקאבל: •

הנכחי לומדת בצעד הנכחיerror correctingחוק עדכון – – בכל זאת ע"י כל היחידותVהניבוי של – רק מעדכן אסוסיאציה אחתR-Wכמו –

S דמיוןחשוב: אקטיבציה של היחידות עפ"י • נקבע ע"י מספר יחידות)CR(כלומר – ה-

ועוד כמה תוספות פחות אלגנטיות – כל גירוי הוא בעצם גירוי מורכב •(בשביל הפחתת הכללה), גירוי עם עוצמה חזקה יותר מפעיל יותר

יחידות (בשביל הצללה) וכו'.

)VR(E totalXX

j

xj

x

xjxj

jjxjtotal

n

n

n

ns

EsV

Configural theoryתוצאות – וכו'negative patterningמסביר חסימה, הצללה, •AB ל-A כמו מ-A ל-ABמנבא הכללה סימטרית מ-• יש ערך גדול A ליחידה של A+; ABo ניבויים כמותיים ספציפיים: •

לבד הוא אינהיביטורי (כי B ערך שלילי. כך גם AB וליחידה של Rמ- מה הניבוי? מה הניבוי B+ ). עתה אם יאמנו ABהצגתו מפעילה את

?R-Wשל לא הסבירוelementalמסביר את התוצאות שתאוריות •אבל: •

(שלפעמים קורה). summationלא מסביר –contextהסבר באמצעות

בעית 'קביעות' של קונפיגורציה – –בכל נקודת זמן הגירוי יכול להראות שונה...

התפוצצות קומבינטורית–

הכללה – חוסר סימטריה

Results (Redhead & Pearce 94)

Rescorla/Wagner model

Pearce model

אימון:A+BC+ABCo

סכימהRescorla/Wagner model

Pearce model

Results (Rescorla 03)

אימון:AB+CD+מבחן:AB, CD(הזוגות שאומנו) AC, BD(העברה/הכללה) A, B, C, D(אלמנטים)

Elemental vs. configural theories•Elemental –

USכל האלמנטים הפעילים נכנסים לאסוסיאציות עם ה-–

דגש על מקרים בהם רואים סכימה של השפעות של גירויים –נפרדים

•Configural – דגש על דמיון בין גירויים כמשפיע על קושי האבחנה ביניהם–

בכל צעד בניסוי נוצרת/מתעדכנת רק אסוסיאציה אחת–

בשתיהן: תפקיד מיוחד לחיזוק (לא מתפקד כגירוי רגיל)•

ניסויי מפתח עם פרדיקציות שונות (למשל לימוד של •)A+,B+,C+,AB+,AC+,BC+,ABCo כל מעבדה מקבלת –

תוצאות שמתאימות למודל שלה...

שאלות חשובותבאילו מצבים נייצר יחידה קונפיגורלית נוספת (ומתי רק 1.

נסכום)?

כאשר מוצג גירוי מסוים – כיצד תתבצע ההכללה 2.לקונפיגורציות אחרות?

איך לחלק את הלמידה בין היחידות השונות?3.

מציעות תשובות configural ו-elementalתאוריות •שונות

אך... לא ברור (משיקולים תאורטים) את מי להעדיף •וגם – אין תמיכה ניסויית חד משמעית באף אחת... •

ואף יש ניסויים שסותרים את שתיהן!

Courville + Dawלאן הולכים מכאן? – 2005

נדמה שכל מודל טוב בסיטואציות אחרות. מה העקרון •שינחה אותנו?

"Pluralitas non est ponenda sine necessitate” Plurality should not be posited without necessity – William of Occam (1349)

הפשוטלפי התער של אוקהם – יש לבחור את המודל • את התצפיותהמסבירביותר

מימוש חישובי: הסקה בייסיאנית• (תער אוקהם אוטומטי)

) של העולםgenerativeמודלים מחוללים (•R-W-מודל מחולל לינארי (כך גם ב – TD(

עם הנראותwחוק הלמידה: מציאת ה-–),maximum likelihoodהגבוהה ביותר (

מסבירים את התצפיות טוב ביותר–Kalman filter-מתיחס ל – w

)latent variables(משתנים חבויים כדינמיים ומנסה להסיק אותם בצורה בייסיאנית

הוספת יחידות קונפיגורליות•בכדי לפתור בעיות לא לינאריות–אבל: אילו יחידות להוסיף ומתי?–

סכימה מול אבחנה•

A B

R

'אור, צליל וכו

'מזון, שוק וכו

wA wB

A B

R

wA wB

AB

wAB

מודל 'משתנים חבויים'

החיה נחשפת לצעדים המוגרלים (זהים ב"ת) מאיזשהו מודל של •העולם. המטרה: להסיק את המודל מהתצפיות

•sigmoid belief network(כל המשתנים בינריים)

ממדלת יחד את הגירויים והחיזוקים•

•xגורמים חבויים – ממדלים קורלציות בין קבוצות ארועים בעולם –

לומדים לא רק משקולות אלא את מבנה המודל עצמו (כמה גורמים •חבויים, בין מי למי החיצים)

A B R

x1 x2 A B

R

Courville, Daw, & Touretzky 2003, 2004

)xwexp(1

1)w,x|stim(P

iiij

j

הסקת מבנה המודל

A B R

A B R

A B R

vs

vs

etc

?באילו "יחידות קונפיגורליות" להשתמש לתאור העולם

Learning & prediction

ע"י חוק בייס (קביעת משקולות נראות P(w,M|data) למידה:•)w,Mלכל מודל

(עפ"י כל המידע עד R המטרה – לדעת מתי יגיע חיזוק ניבוי:•עכשיו, והגירויים בצעד הנכחי)

– P(R|stim,data)) ע"י מיצוע -marginalization מעבר לכל (המודלים האפשריים (ממושקל עפ"י סבירותם) והמשקולות

)explaining awayמתיחס גם לשילובים של גורמים חבויים (– כי גורם נחשב סביר אם Pearceבסופו של דבר, דומה ל-–

תוצאותיו דומות למה שמוצג בצעד הנכחי

( , | ) ( | , ) ( , )P w M data P data w M P w M

A B R

( | , ) ( | , , ) ( | , ) ( | )M

P R stim data d P R stim M P M data P M dataw w w

פשטות מול דייקנותהתפלגות א-פריורית מעדיפה מודלים פשוטים (מעט •

יחידות, מעט קשרים, משקולות קטנות) מאבד מחשיבותו priorככל שמתווסף מידע מהעולם ה-•

ועוברים למודלים מסובכים (אך מדוייקים) יותר

בין tradeoffזהו סימן ההיכר של הסבר בייסיאני: •נאמנותו לנתונים המודל לסיבוכיות

סכימה

Results (Rescorla 03)Bayesian model

MAP model structure:אימון:AB+CD+מבחן:AB, CD(הזוגות שאומנו) AC, BD(העברה/הכללה) A, B, C, D(אלמנטים)

אי-סימטריה בהכללה

Results (Redhead & Pearce 94) Bayesian model

MAP model structure:

התניה מסדר שני מול התניה אינהיביטורית

:דומותפרוצדורות מאוד •ABo, שלב ב' – +Aהתניה מסדר שני: –A+, ABoהתניה אינהיביטורית: –

אורך האימון משפיע על דפוס התוצאות••Yin et al. 1994 צעדים משולבים של – A+, ABo

התניה מסדר שני אקסיטטורי (מנבא חיזוק) B: מעט צעדים– אינהיביטורי B: הרבה צעדים–

(מנבא העדר חיזוק צפוי)

אז מה היה לנו?שלושה נדבכים בקורס: •

התנהגות–מודלים חישוביים–מח–

השפיע על הדגש, על נסיון לקשור את כל הרמות •בחירת הנושאים

חזרה לרמת העל – איפה היער?•

התנהגות: התניההתנהגות: התניה)?control) ושליטה (predictionאיך בע"ח לומדים ניבוי ( :הבעיה

תכנון : התנהגות מורכבת – ריבוי מנגנונים ואינטראקציותהשיטהניסויים שיביאו לידי ביטוי אחד ויורידו למינימום השפעתם של

אחרים. זהירות: דיכוטומיות

(ניבוי). התניה קלאסית 1 שני סוגי התניה:

(שליטה). התניה אופרנטית 2

דברים שהיו חשובים:

- מה נלמד? (תכולת אינפורמציה – ערך, סוג חיזוק וכו')

- באילו תנאים מתקיימת הלמידה? (סמיכות, הפתעה וכו')

ייצוג, אסוסיאציה, סמיכות, מפה קוגניטיבית:מושגים

Whatever is good to know is hard to learn – Greek proverb

מודלים חישובייםמודלים חישובייםניבוי והתנהגות אופטימלים, הסבר לתופעות התנהגותיות :הבעיה

, RL), מודלים נורמטיבים (R-W: מודלים תאוריים (השיטהבייסיאנים)

דברים שהיו חשובים:

) שההתנהגות מציבה?constraints (המגבלות- מהם ההתנהגותיים/חישוביים שהמודל תופס ומאילו האספקטיםמהם -

הוא מתעלם?? איך המודלים מעצבים את המחקר הניסויי-

value, forward model, cache, generative model: מושגים

All models are wrong, some models are useful – G. Box

מנגנונים מוחייםמנגנונים מוחיים actionכיצד המח מממש למידה, ניבוי ושליטה ( :הבעיה

selection?(

), fMRI, EEG, PET רישומים בחיה מתנהגת, הדמיות (:השיטה), פרמקולוגיהlesionsפגיעות (

דברים שהיו חשובים:

תפקיד כללי של אזור/נוירומודולטורהכללות:-

דיסוסיאציות בין תפקידים/אזורים/נוירומודולטוריםהבחנות:-

, גרעינים בזליים, אמיגדלה, קורטקס פרונטלי, Achדופמין, : מושגיםהיפוקמפוס, (סינפסות, רצפטורים)

In theory, there is no difference between theory and practice, but not in practice. - Anonymous

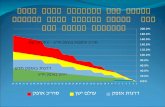

מבט מגבוה חוק ניסויי מפתח 3התניה קלאסית א' – מתי מתרחשת למידה? •

R-Wולמידה בעזרת דופמין

התניה קלאסית ב' – אקסיטטורי/אינהיביטורי אפטטיבי/אברסיבי •)Konorski, fMRI ,של התניה אברסיבית Kalman filter(

Actor-Critic, מודל Thorndike, Skinnerהתניה אופרנטית א' – •

, דופמין טוניfree operant – energizing vs directingמוטיבציה ו-•

– הרגלים R-O, devaluation מול S-Rהתניה אופרנטית ב' – •, שתי מע' במחcacheוהתנהגות מונחית מטרה, חישוב ע"י עץ או ע"י

PITקלאסית ואינסטרומנטלית – מגנון אחד או שניים? השמטה, •

הכחדה – תאוריות שונות, אין מודלים•

כמודל פרמקולוגי לשני קטבי LIלמידה חבויה וסכיזופרניה – •ההפרעה

Ach), אמיגדלה, KFקשב ואסוציאביליות – הפרדה בין ניבוי ללמידה (•

הכללה ואבחנה – למידה/הסקה של מודל של העולם•

תודה רבה לכם!